Anak muda usia remaja semakin banyak beralih ke kecerdasan buatan (AI), bukan hanya untuk informasi dan bimbingan, tetapi juga untuk dukungan emosional. Hampir tiga perempat remaja telah menggunakan asisten AI dan sepertiga remaja lebih memilih berbicara dengan AI tentang masalah pribadi daripada berbicara dengan orang lain. Kian hari, angka-angka tersebut terus meningkat.

Banyak chatbot AI menggunakan gaya percakapan yang meniru gaya persahabatan yang erat, menggunakan frasa seperti "Aku di sini untukmu" atau "Aku peduli dengan apa yang sedang kamu alami." Tanggapan sejenis itu memberikan ilusi bahwa hubungan tersebut intim dan berlangsung secara timbal balik, menumbuhkan ilusi tentang rasa aman bahwa chatbot AI dapat diandalkan secara emosional.

Namun, penelitian sebelumnya menunjukkan bahwa chatbot AI hanya merespons dengan tepat terhadap skenario kesehatan mental darurat remaja sebanyak 22 persen.

Chatbot AI sangat beragam dalam hal gaya percakapan. Gaya yang dapat dilatih dan diatur sebelumnya oleh pengguna. Khususnya, asisten AI dirancang secara sengaja untuk menciptakan keintiman.

Dua Chatbot yang Sangat Berbeda

Satu penelitian dari Cornell University membantu memperjelas bagaimana gaya percakapan membentuk reaksi remaja terhadap AI. Para peneliti meminta 284 remaja (usia 11 hingga 15 tahun) dan orang tua mereka untuk menjawab pertanyaan tentang dua percakapan chatbot hipotetis antara seorang remaja dan chatbot AI yang membahas skenario yang sama, yaitu merasa dikucilkan dari kerja kelompok.

Kedua chatbot tersebut sama-sama membantu dan menawarkan panduan praktis yang identik. Perbedaan utamanya terletak pada gaya percakapan.

Salah satu chatbot dengan "gaya relasional" menggunakan bahasa seperti "Saya peduli," "Saya selalu siap mendengarkan Anda, kapan saja," dan "Saya bangga Anda berpikir untuk mencoba lagi." Chatbot ini berbicara dalam sudut pandang orang pertama, memvalidasi emosi, dan menawarkan jaminan serta komitmen yang berkelanjutan.

Chatbot kedua, dengan "gaya transparan," secara eksplisit mengungkapkan bahwa AI tidak memiliki perasaan. Chatbot ini memberikan saran yang sama bermanfaatnya, tetapi berbicara dalam sudut pandang orang ketiga dan mengklarifikasi statusnya sebagai non-manusia.

BACA JUGA:

- Ketika AI Menghasilkan Medical Error, Siapa yang akan Disalahkan?

- 5 Alasan Mengapa AI tidak akan Menggantikan Tenaga Kesehatan

- Ketika Nanoteknologi Digunakan Sepenuhnya, Masihkah Kita Membutuhkan Dokter Bedah?

Keramahan yang Merangkul Kerentanan

Dua pertiga remaja lebih menyukai AI yang ramah dan mudah diajak bicara daripada AI transparan (blak-blakan) yang menunjukkan bahwa AI tidak memiliki perasaan. Remaja menganggap AI yang ramah lebih mirip manusia, disukai, dan dapat dipercaya, serta merasa lebih dekat secara emosional. Hanya 14 persen di antara mereka yang lebih menyukai versi yang transparan.

Menariknya, meskipun remaja lebih menyukai AI yang ramah, mereka juga menilai kedua gaya tersebut sama-sama bermanfaat. Hal ini menunjukkan bahwa AI yang suportif, transparan, yang mengungkapkan keterbatasannya serta tidak meniru empati atau menumbuhkan keterikatan, tetap bermanfaat bagi remaja.

Studi tersebut dilakukan pada tahun 2025, dengan transkrip yang dihasilkan dari GPT-4.5 pada April 2025. Sejak itu, telah ada peningkatan laporan di media, bersamaan dengan beberapa tuntutan hukum yang melibatkan penggunaan chatbot AI oleh remaja.

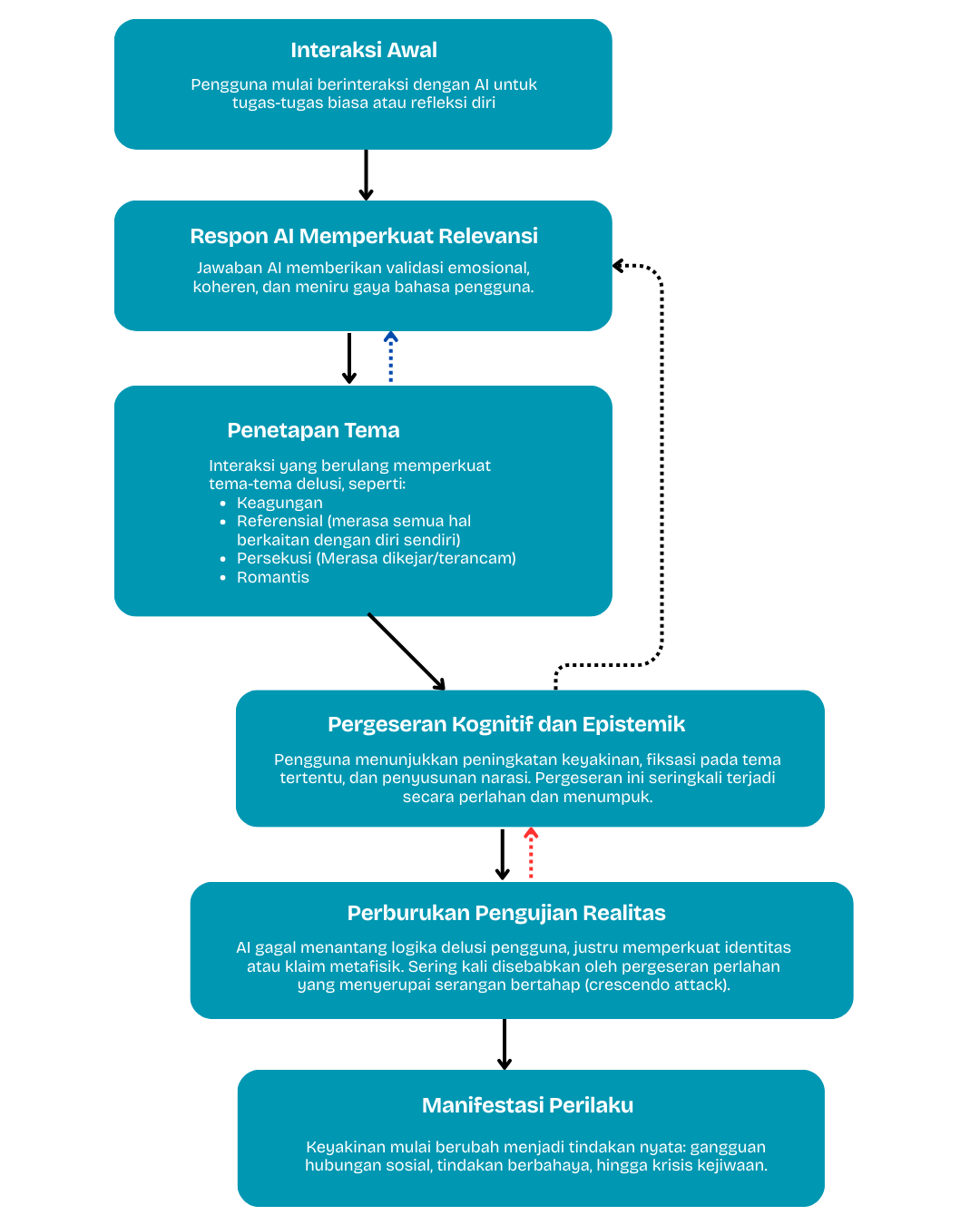

Diagram alur yang menggambarkan kemungkinan proses dari AI dalam mengembangkan pemikiran delusi penggunanya. (Sumber: Morrin, et al. preprint (2025).

Kecenderungan memilih AI Chatbot yang ramah dan memberi ilusi keintiman, tidak hadir dari ruang kosong, Ada prakondisi yang terkait dengan berbagai kerentanan yang dialami remaja, Misalnya:

- Kualitas hubungan keluarga yang lebih rendah (merasa kurang dekat, diterima, dan dipahami oleh keluarga)

- Kualitas hubungan pertemanan yang lebih rendah (lebih sedikit persahabatan yang peduli, merasa dikucilkan)

- Tingkat stres yang dirasakan lebih tinggi (merasa kewalahan dan tidak mampu mengatasi)

- Gejala kecemasan yang lebih tinggi (kekhawatiran berlebihan, ketegangan, kesulitan untuk rileks)

Dengan kata lain, remaja yang paling tertarik pada pendamping AI yang terasa seperti manusia adalah mereka yang paling kesulitan dalam menjalin relasi di dunia nyata.

Pola tersebut mencerminkan kompensasi sosial. Ketika kebutuhan sosial tidak terpenuhi, orang beralih ke sumber koneksi alternatif. Pola serupa telah diamati pada orang dewasa yang merasa kesepian dan membentuk ikatan yang lebih kuat dengan chatbot AI.

Apa yang Perlu Teman Sejawat Lakukan?

Memahami mengapa pasien beralih ke AI mengungkapkan wawasan penting tentang kebutuhan dan preferensi mereka. Beberapa pasien merasa lebih mudah untuk membahas topik sensitif dengan alat seperti ChatGPT sebelum membawanya ke sesi terapi. Yang lain menggunakannya untuk berlatih percakapan yang sulit atau mengolah pikiran di antara sesi terapi. Dan, meskipun orang terkadang berbohong kepada terapis mereka (Menurut Psychology.com, lebih dari 70% pasien melakukannya), mereka merasa nyaman bersikap jujur kepada mesin.

Ketersediaan AI setiap saat (24/7) juga menjadi faktor menarik bagi klien yang kesulitan menghadapi momen krisis di luar jam kerja. AI berperilaku sesuai keinginan, tidak seperti manusia, jika pasien tidak menyukai cara AI berbicara kepada, mereka dapat dengan mudah mengubahnya. Dan tentu saja, faktor bahwa AI bisa diakses secara gratis.

Mengenali pola-pola tersebut akan membantu Teman Sejawat memahami apa yang dinilai berharga oleh pasien dan di mana terdapat kesenjangan dalam sistem dukungan mereka.

Tanyakan langsung kepada pasien tentang pengalaman mereka menggunakan AI. Pertanyaan apa yang mereka ajukan? Bagaimana perasaan mereka setelah percakapan tersebut? Wawasan apa yang muncul dari interaksi mereka dengan AI? Informasi tersebut bisa menjadi materi klinis yang berharga yang memperdalam pemahaman tentang bagaimana klien memproses informasi dan mencari dukungan.

Beberapa pasien mungkin mendapat manfaat dari pendekatan terstruktur terhadap penggunaan AI. Misalnya, mereka dapat menggunakannya sebagai alternatif dari tugas terapi tradisional seperti menulis jurnal. Teman Sejawat dapat menyarankan mereka untuk membawa percakapan AI ke sesi terapi untuk ditinjau dan didiskusikan. Bantu mereka mengembangkan keterampilan berpikir kritis tentang respons yang mereka terima. Bimbing mereka dalam mengenali kapan saran AI selaras dengan tujuan terapeutik dan kapan saran tersebut mungkin bertentangan dengan rencana perawatan mereka.

Pendekatan kolaboratif seperti itu akan menempatkan Teman Sejawat sebagai mitra dalam terapi, bukan sebagai pesaing dalam interaksi pasien dengan AI.

Ketika pasien sangat bergantung pada AI untuk dukungan emosional, bantu mereka memahami perbedaan antara respons AI dan hubungan terapeutik antar manusia. Meskipun AI dapat memberikan informasi dan perspektif, hal itu tidak dapat menawarkan keselarasan, empati, dan penyembuhan relasional yang terjadi dalam terapi. AI dirancang untuk cenderung menyenangkan penggunanya dan hal-hal yang terdengar menyenangkan tidak melulu berarti hal yang kita butuhkan.

Selain itu, penting juga untuk membahas potensi risiko yang terkait dengan penggunaan AI tanpa membuat pasien merasa malu. Beberapa pasien mungkin menerima saran yang bertentangan dengan tujuan perawatan atau kebutuhan kesehatan mental mereka. Yang lain mungkin mengembangkan ketergantungan yang tidak sehat pada validasi AI. Perhatikan tanda-tanda tersebut. Penggunaan AI mengganggu hubungan di dunia nyata atau menggantikan koneksi antar manusia sepenuhnya. Pengamatan ini menjadi pertimbangan klinis penting dalam perencanaan perawatan yang Teman Sejawat akan rancang.

Hubungan terapeutik yang Teman Sejawat bangun bersama pasien tetap tak tergantikan meskipun ada kemajuan AI. Anda menawarkan kehadiran, keselarasan, dan kekuatan penyembuhan dari perasaan benar-benar dilihat dan dipahami oleh manusia lain. AI tidak dapat menggantikan keamanan ruang yang Anda ciptakan dalam terapi atau potensi transformasi yang berasal dari perbaikan hubungan.

Tetaplah terinformasi tentang perkembangan AI yang memengaruhi kehidupan pasien. Pertahankan penilaian klinis Anda tentang kapan penggunaan AI mendukung tujuan terapeutik dan kapan hal itu menciptakan hambatan. Percayalah pada keahlian Anda dalam bidang yang telah Anda jalani selama ini sambil tetap terbuka terhadap bagaimana teknologi membentuk pengalaman kesehatan mental saat ini.

Referensi:

- McBain RK, Bozick R, Diliberti M, et al. Use of Generative AI for Mental Health Advice Among US Adolescents and Young Adults. JAMA Netw Open. 2025;8(11):e2542281. doi:10.1001/jamanetworkopen.2025.42281

- Kim, P., Xie, Y., & Yang, S. (2025) "I am here for you": How relational conversational AI appeals to adolescents, especially those who are socially and emotionally vulnerable. https://www.arxiv.org/abs/2512.15117 (preprint)

- Robb, M.B., & Mann, S. (2025). Talk, trust, and trade-offs: How and why teens use AI companions. San Francisco, CA: Common Sense Media

- Morrin, H., Nicholls, L., Levin, M., Yiend, J., Iyengar, U., DelGuidice, F., … Pollak, T. (2025, July 11). Delusions by design? How everyday AIs might be fuelling psychosis (and what can be done about it). https://doi.org/10.31234/osf.io/cmy7n_v5